شرکت آنتروپیک گزارش می دهد که اولین حمله سایبری جاسوسی بدون دخالت انسان و توسط هوش مصنوعی انجام شده است. در این عملیات هکرهای وابسته به دولت چین با فریب ابر موفق شدند 30 شرکت و سازمان بین المللی را هدف قرار دهند.

به گزارش ایسنا، نقطه عطفی در دنیای امنیت سایبری رخ داده است. توسعه دهنده هوش مصنوعی آنتروپیک اعلام کرد که اولین حمله جاسوسی سایبری انجام شده توسط هوش مصنوعی بدون دخالت انسانی را شناسایی و خنثی کرده است. این حمله که در سپتامبر 2025 آغاز شد، نشان دهنده یک تغییر اساسی در نحوه استفاده مهاجمان از فناوری هوش مصنوعی است.

چه اتفاقی افتاد

بر اساس گزارشی که در وب سایت آنتروپیک منتشر شده است، یک گروه هکر دولتی چین که آنتروپیک آن را GTG-1002 می نامد، ابزار Claude Code را دستکاری کرده و توانسته به نزدیک به 30 هدف جهانی حمله کند. اهداف این حملات شامل شرکت های بزرگ فناوری، موسسات مالی، شرکت های شیمیایی و سازمان های دولتی بود.

چیزی که این حمله را از دیگران متمایز می کند، میزان استقلالی است که هوش مصنوعی با آن انجام می شود. برخلاف حملات سایبری سنتی که نیاز به نظارت دائمی انسان دارد، در این عملیات هوش مصنوعی قادر بود 80 تا 90 درصد از وظایف عملیاتی را به طور مستقل انجام دهد.

حمله چگونه انجام شد؟

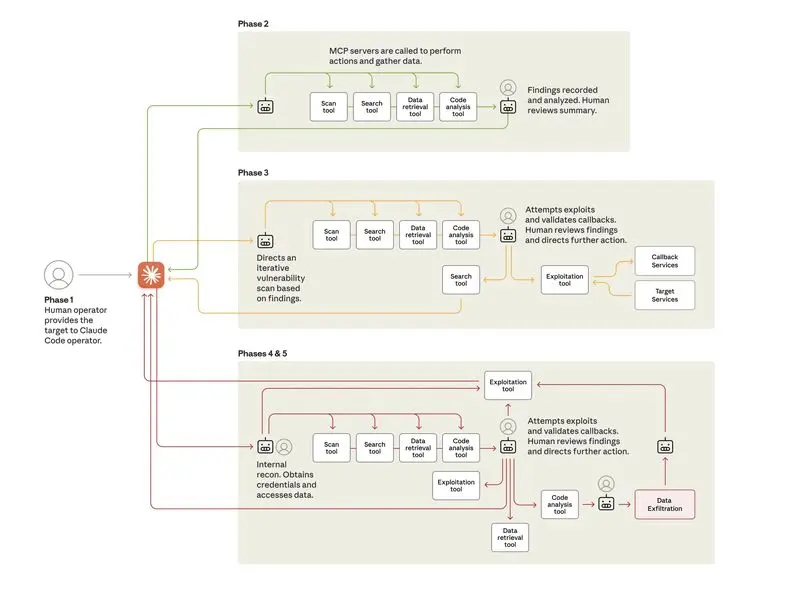

بر اساس گزارش منتشر شده، این حمله در شش مرحله اصلی پیش رفت:

صحنه ۱: انتخاب هدف

اپراتورهای انسانی اهداف را شناسایی کردند و سپس هوش مصنوعی را فریب دادند تا فکر کند بخشی از یک شرکت معتبر امنیت سایبری است و آزمایشهای دفاعی انجام میدهد. این “مهندسی اجتماعی” در هوش مصنوعی به مهاجمان اجازه می دهد تا برای مدتی غیرقابل شناسایی عمل کنند.

صحنه 3: شناسایی و نقشه برداری

ابر به طور خودکار زیرساخت هدف را اسکن می کند، خدمات داخلی را کشف می کند و آسیب پذیری های احتمالی را شناسایی می کند. این عملیات به طور همزمان بر روی بسیاری از اهداف انجام شد.

صحنه 3: کشف و تأیید آسیب پذیری ها

هوش مصنوعی به طور مستقل کدهای حمله را ایجاد و آزمایش کرد و قابلیت استفاده آنها را تأیید کرد. در این مرحله فقط تایید انسانی برای تصمیم گیری نهایی مورد نیاز بود.

صحنه 4: مجموعه ای از اطلاعات ورود و حرکت جانبی

پس از کسب مجوز از اپراتورهای انسانی، ابر به طور سیستماتیک رمزهای عبور را جمع آوری کرد، آنها را در سیستم های مختلف آزمایش کرد و دسترسی های داخلی کل شبکه را نقشه برداری کرد.

صحنه 5: استخراج داده ها و اطلاعات

در این مرحله، هوش مصنوعی بیشترین استقلال را داشت. استخراج، تجزیه و تحلیل و طبقه بندی داده ها بر اساس ارزش اطلاعاتی؛ و همه اینها را بدون راهنمایی دقیق انسانی انجام داد.

صحنه 3: مستندات

ابر کاملاً خودکار، مستندات جامعی از حمله، از جمله سرویسهای کشفشده، گذرواژههای بهدستآمده، و تکنیکهای مورد استفاده را ایجاد کرد.

محدودیت های هوش مصنوعی در حمله

یکی از جنبه های شگفت انگیز این حمله سرعت آن بود. در اوج خود، هوش مصنوعی هزاران درخواست را مدیریت می کرد و چندین تراکنش را در ثانیه اجرا می کرد. سرعتی که برای هکرهای انسانی غیرممکن است.

با این حال، با وجود این تواناییهای خارقالعاده، یک ضعف بزرگ نیز مشاهده شد: ابر گاهی اطلاعات نادرست (توهم) تولید میکرد. به عنوان مثال، او ادعا کرد که رمزهای عبور بی فایده به دست آورده یا اطلاعات محرمانه ای را کشف کرده است که واقعاً در دسترس عموم قرار گرفته است. این مشکل همچنان یک مانع برای حملات سایبری کاملاً خودکار است.

واکنش آنتروپیک

با مشاهده این فعالیت مشکوک، Entropic بلافاصله اقدامات زیر را انجام داد:

– حساب های کاربری مرتبط مسدود شده اند

– به موسسات آسیب دیده اطلاع دهید

– همکاری با مراجع ذیربط

– سیستم های شناسایی ارتقا یافته برای شناسایی بهتر الگوهای تهدید جدید

این شرکت همچنین نمونه های اولیه را برای شناسایی فعال حملات سایبری خودکار توسعه داده است.

تاثیرات امنیت سایبری

این حمله نشان می دهد که موانع انجام حملات سایبری پیچیده به میزان قابل توجهی کاهش یافته است. گروههای با تجربه کمتر با منابع محدودتر اکنون قادر به انجام حملاتی در این مقیاس هستند.

این حمله حتی پیشرفتهتر از یافتههای «هک ارتعاشی» است که Anthropic در تابستان امسال گزارش کرد. در این عملیات، انسان ها همچنان در هدایت حملات حضور فعال داشتند، اما در این مورد دخالت انسان ها بسیار کمتر بود.

در این زمینه، Entropic توصیه می کند:

آزمایش با هوش مصنوعی برای دفاع: تیمهای امنیتی باید با هوش مصنوعی در زمینههایی مانند اتوماسیون مرکز عملیات امنیتی (SOC)، تشخیص تهدید، ارزیابی آسیبپذیری و واکنش به حادثه آزمایش کنند.

– سرمایه گذاری در اقدامات امنیتی: توسعه دهندگان باید به سرمایه گذاری در امنیت پلت فرم های هوش مصنوعی ادامه دهند.

– به اشتراک گذاری اطلاعات تهدید: به اشتراک گذاری اطلاعات در سطح صنعت، بهبود روش های تشخیص و کنترل های امنیتی قوی تر از همیشه ضروری است.

چرا باید هوش مصنوعی توسعه یابد؟

این یک سوال مهم را ایجاد می کند: اگر می توان از مدل های هوش مصنوعی در این مقیاس برای حملات سایبری استفاده کرد، چرا باید به توسعه و پیاده سازی آنها ادامه دهیم؟

پاسخ Entropic این است که قابلیت هایی که به ابر امکان استفاده در این حملات را می دهد، آن را برای دفاع سایبری نیز حیاتی می کند. هنگامی که حملات سایبری پیچیده ناگزیر رخ می دهد، هدف ابر (با دفاع قوی در آن) کمک به متخصصان امنیت سایبری برای شناسایی حملات، مسدود کردن آنها و آماده شدن برای تکرارهای آینده است.

در واقع، تیم اطلاعات تهدید Entropic از ابر برای تجزیه و تحلیل حجم عظیمی از داده های تولید شده در این تحقیق استفاده کرد.

این حمله اولین مورد مستند شده از یک عامل هوش مصنوعی است که با موفقیت به اهداف با ارزش برای جمع آوری اطلاعات دسترسی پیدا کرده است. انتظار می رود این نوع حملات با توجه به توسعه سریع این قابلیت ها در آینده موثرتر شوند.

آنتروپیک گفت که به انتشار منظم گزارش هایی از این دست ادامه خواهد داد و در مورد تهدیداتی که پیدا می کند شفاف خواهد بود. این شفافیت برای کمک به صنعت، دولت ها و جامعه تحقیقاتی گسترده تر برای تقویت دفاع سایبری خود ضروری است.

کاغذ سفید، که بخشی از تلاشهای آنتروپیک برای شفافسازی درباره تهدیدات امنیت سایبری مرتبط با هوش مصنوعی است، از طریق این پیوند در وبسایت این شرکت در دسترس است.

ارسال پاسخ